Introduction

Le monde des réseaux informatiques est en constante évolution, et explore les nouvelles technologies qui transforment la façon dont les données sont acheminées à travers les réseaux modernes.

Technologies de Routage Avancées

Évolution d’OSPF (Open Shortest Path First)

Le protocole OSPF a connu des améliorations significatives pour répondre aux besoins des réseaux contemporains. Dans la version 1.1 du CCNA, une attention particulière est portée à ces évolutions.

L’OSPFv3 constitue une extension majeure, conçue spécifiquement pour prendre en charge IPv6. Cette version maintient les principes fondamentaux d’OSPF tout en s’adaptant aux adresses 128 bits d’IPv6. Les messages LSA (Link State Advertisement) ont été restructurés pour accommoder ces adresses plus longues, et le protocole fonctionne désormais sur une base de lien plutôt que de sous-réseau, ce qui offre une flexibilité dans les environnements à adressage mixte.

Les fonctionnalités d’authentification d’OSPF ont également été renforcées. Si l’authentification par mot de passe simple était la norme, le protocole supporte maintenant l’authentification MD5 et SHA pour des communications plus sécurisées entre routeurs.

Une autre innovation importante est l’OSPF multi-zones hiérarchique avancé. Cette approche permet une segmentation plus fine du réseau en zones distinctes, réduisant ainsi la charge de traitement sur les routeurs et optimisant la convergence du réseau.

Le concept de zone totalement stubby et de zone not-so-stubby (NSSA) offre un contrôle précis sur la propagation des informations de routage, permettant aux administrateurs d’équilibrer visibilité et performance selon les besoins spécifiques de chaque segment du réseau. Pour ceux qui connaisse le CCNP, ces notions étaient abordées durant le CCNP. Cisco a descendu ces concepts dans cette nouvelle version du CCNA.

Améliorations d’EIGRP (Enhanced Interior Gateway Routing Protocol)

EIGRP, bien que propriétaire à Cisco, reste un protocole très utilisé dans les réseaux d’entreprise.

Le support IPv6 natif d’EIGRP représente une évolution majeure, permettant l’utilisation du protocole dans des environnements à double pile IP. Cette version modernisée conserve les avantages classiques d’EIGRP comme la convergence rapide et l’utilisation efficace de la bande passante, tout en les étendant aux réseaux de nouvelle génération supportant IPv6.

EIGRP a également intégré des fonctionnalités avancées de contrôle de bande passante. Les mécanismes de régulation du trafic permettent désormais de limiter précisément la quantité de bande passante utilisée par le protocole, ce qui est particulièrement utile sur les liens à faible débit ou dans les réseaux où la capacité doit être partagée entre plusieurs services critiques.

L’introduction de l’EIGRP Named Mode constitue un changement fondamental dans la configuration du protocole. Cette approche orientée composants simplifie la gestion en regroupant tous les paramètres, ce qui facilite considérablement la configuration et le dépannage des réseaux.

Sélection de Chemin Optimale

La technologie PBR (Policy-Based Routing) permet de définir des politiques de routage qui prennent en compte des critères autres que la simple destination. Les administrateurs peuvent ainsi acheminer le trafic en fonction de paramètres comme l’adresse source, le type de protocole, ou même la taille des paquets, offrant une granularité sans précédent dans la gestion du trafic. Ne le croyez pas inutile, le PBR est très utilisé en production.

Le routage sensible à la qualité de service représente une avancée significative. En intégrant des métriques de QoS comme la latence, la gigue ou le taux de perte de paquets dans les décisions de routage, les réseaux peuvent désormais adapter dynamiquement leurs chemins pour satisfaire les exigences spécifiques des applications sensibles comme la voix sur IP ou la vidéoconférence.

Les techniques de répartition de charge avancées permettent d’optimiser l’utilisation de chemins multiples. Au-delà du simple partage de charge à coûts égaux (ECMP), les routeurs peuvent désormais distribuer le trafic proportionnellement à la capacité de chaque lien, ou même adapter cette répartition en fonction de la congestion observée en temps réel.

Stratégies de Redistribution de Routes

La redistribution de routes entre différents protocoles est une compétence essentielle pour la certification mais aussi dans la vraie vie.

Les techniques de filtrage sélectif permettent un contrôle précis des routes redistribuées. À l’aide de filtres basés sur des préfixes, des attributs de routes ou des tags, les administrateurs peuvent définir exactement quelles routes doivent être partagées entre protocoles, limitant ainsi la propagation d’informations inutiles et améliorant la stabilité du réseau.

La manipulation de métriques lors de la redistribution est délicat. On peut influencer les décisions de routage à travers les frontières des protocoles, garantissant des chemins optimaux. Mais attention à la mauvaise configuration et tout le reseau peut planter.

L’utilisation de tags administratifs, la configuration de distances administratives appropriées, et l’emploi judicieux de filtres bidirectionnels permettent de prévenir les problèmes courants liés à la redistribution, assurant ainsi la stabilité de l’infrastructure.

Virtualisation des Fonctions Réseau (NFV)

Principes Fondamentaux de NFV

La NFV représente un changement fondamental dans la conception des réseaux.

L’architecture NFV standardisée par l’ETSI est présentée en détail. Cette structure en couches comprend l’infrastructure NFV (NFVI), qui fournit les ressources virtualisées, le gestionnaire d’infrastructure virtualisée (VIM), qui orchestre ces ressources, et les fonctions réseau virtualisées (VNF) elles-mêmes, qui remplacent les équipements physiques traditionnels.

Le découplage entre matériel et logiciel constitue l’essence même de la NFV. En séparant les fonctions réseau du matériel sous-jacent, cette approche permet une flexibilité dans le déploiement et la gestion des services réseau. Les fonctions auparavant intégrées dans des équipements dédiés peuvent désormais s’exécuter comme des applications sur des serveurs standard.

Les hyperviseurs et technologies de conteneurisation jouent un rôle central dans cet écosystème.

Services Réseau Virtualisés

La virtualisation a transformé la façon dont les services réseau sont déployés et gérés.

Les routeurs virtuels représentent l’une des applications les plus évidentes de la NFV. Ces fonctions logicielles peuvent désormais fournir des capacités de routage avancées sans nécessiter d’équipement physique dédié, ce qui réduit considérablement les coûts d’acquisition et de maintenance, tout en offrant une flexibilité accrue pour le déploiement et la mise à l’échelle.

Les pare-feu virtuels constituent une autre fonction réseau communément virtualisée. Ces solutions logicielles peuvent être déployées rapidement à différents points du réseau, et leur configuration peut être automatisée pour s’adapter aux menaces émergentes ou aux changements dans la topologie du réseau.

Les fonctions de WAN virtuel, comme les contrôleurs SD-WAN, illustrent parfaitement les avantages de la NFV. Ces solutions permettent une gestion centralisée des liens WAN, optimisant le routage en fonction des conditions actuelles du réseau et des exigences des applications, le tout sans intervention manuelle sur les équipements distants.

Avantages en Matière d’Agilité et de Coût

La réduction des coûts matériels constitue l’un des avantages les plus immédiats. En remplaçant des équipements propriétaires dédiés par des serveurs standard exécutant des fonctions virtualisées, les entreprises peuvent réaliser des économies significatives sur leurs investissements en infrastructure.

L’accélération du déploiement des services représente un atout concurrentiel majeur. Là où le déploiement d’équipements physiques pouvait prendre des semaines, les fonctions virtualisées peuvent être mises en service en quelques minutes, permettant aux organisations de répondre rapidement aux nouvelles opportunités ou menaces.

La flexibilité et l’élasticité accrues transforment la gestion des capacités réseau. Les ressources peuvent être allouées dynamiquement en fonction des besoins réels, et la mise à l’échelle s’effectue sans interruption de service, simplement en ajustant les ressources virtuelles attribuées à chaque fonction.

Cas d’Utilisation dans les Réseaux d’Entreprise

Les succursales illustrent parfaitement l’intérêt de la NFV. En pré-configurant des appliances universelles qui peuvent héberger toutes les fonctions réseau nécessaires, les entreprises peuvent ouvrir de nouveaux sites en un temps record, sans nécessiter l’intervention d’experts réseau sur place. Fini d’attendre que le routeur arrive a bon port.

L’isolation et la segmentation avancées des environnements multi-locataires deviennent beaucoup plus simples grâce à la NFV. Des instances virtuelles dédiées peuvent être créées pour chaque locataire, garantissant une séparation complète tout en maximisant l’utilisation des ressources physiques sous-jacentes.

Les laboratoires et environnements de test temporaires bénéficient particulièrement de cette approche. Des répliques fidèles de l’infrastructure de production peuvent être créées rapidement pour tester des configurations ou des mises à jour, puis détruites lorsqu’elles ne sont plus nécessaires, le tout sans impact sur l’environnement opérationnel.

Multicast Avancé

Protocole PIM (Protocol Independent Multicast) en Détail

Le multicast reste essentiel pour les applications de diffusion efficace, et le CCNA 1.1 approfondit ce sujet complexe.

Les différents modes de PIM sont analysés en profondeur. Le mode dense (PIM-DM), basé sur l’inondation initiale puis l’élagage, convient aux environnements à haute densité de récepteurs. Le mode sparse (PIM-SM), qui utilise un modèle explicite de jointure, s’avère plus efficace dans les réseaux étendus où les récepteurs sont dispersés. Le mode bidirectionnel (PIM-BiDir) offre une alternative économe en ressources pour les applications à multiples sources et récepteurs.

L’arbre de chemin le plus court (SPT) minimise la latence entre la source et chaque récepteur, tandis que l’arbre partagé offre une utilisation plus efficace des ressources du réseau au prix d’une latence potentiellement plus élevée.

Les mécanismes de découverte de source multicast permettent aux routeurs d’identifier dynamiquement les sources actives dans le réseau. Des protocoles comme MSDP (Multicast Source Discovery Protocol) facilitent le partage de ces informations entre domaines PIM, permettant ainsi la communication multicast à l’échelle inter-domaine.

Rendezvous Points (RP) et leur Configuration

Les points de rendez-vous jouent un rôle central dans PIM-SM, et leur configuration optimale est cruciale pour les performances du réseau multicast.

Les méthodes de configuration statique des RP offrent un contrôle maximal mais nécessitent une maintenance manuelle. Cette approche, bien que simple, peut poser des problèmes de fiabilité en cas de défaillance du RP désigné, à moins qu’une redondance appropriée ne soit mise en place.

Les techniques de découverte automatique des RP, comme Auto-RP et Bootstrap Router (BSR), permettent une configuration plus dynamique et résiliente. Ces mécanismes distribuent automatiquement les informations sur les RP disponibles, facilitant ainsi la mise en place de topologies multicast robustes et auto-cicatrisantes.

La technologie Anycast RP représente une avancée significative pour la redondance et l’équilibrage de charge. En associant la même adresse IP à plusieurs routeurs RP physiques, cette approche garantit une haute disponibilité tout en optimisant le routage multicast en fonction de la proximité topologique.

Optimisation de la Diffusion Multicast

Les mécanismes de contrôle de la portée multicast permettent de limiter la propagation du trafic aux zones du réseau où il est réellement nécessaire. Des techniques comme TTL scoping et les frontières administratives multicast aident à contenir le trafic, réduisant ainsi la consommation inutile de ressources réseau.

L’optimisation de la convergence multicast est essentielle pour minimiser les perturbations lors des changements de topologie. Des fonctionnalités comme PIM Non-Stop Forwarding et les temporizateurs ajustés permettent de maintenir la continuité du service multicast même en cas de défaillance d’un composant du réseau.

Les mécanismes de sécurité multicast sont également abordés en détail. La limitation du nombre de groupes multicast, le filtrage des sources autorisées et la protection contre les attaques de type « rogue RP » contribuent à créer un environnement multicast sécurisé et contrôlé.

Applications Multicast Modernes

La distribution de contenu média constitue l’application la plus évidente. Que ce soit pour la diffusion d’événements en direct, les vidéoconférences d’entreprise ou les flux IPTV, le multicast permet de transmettre efficacement des contenus à haute bande passante à de multiples destinataires simultanément.

Les mises à jour de données financières en temps réel représentent un cas d’utilisation critique où les performances sont cruciales. Chaque milliseconde compte dans ce secteur, et le multicast permet de distribuer instantanément les cotations et autres données financières à tous les systèmes concernés, sans multiplier les flux individuels qui satureraient rapidement les liaisons réseau.

Les mises à jour logicielles et distributions de patches à grande échelle bénéficient également du multicast. Dans les environnements comptant des centaines ou milliers de postes nécessitant des mises à jour simultanées, cette technologie permet de réduire considérablement la charge sur le réseau et d’accélérer le déploiement.

Overlay Networks et Tunneling

Fondamentaux des Réseaux Overlay

Les réseaux overlay constituent une extension des architectures modernes.

Le concept fondamental de découplage des topologies physiques et logiques est au cœur des réseaux overlay. Cette approche permet de créer des connexions virtuelles qui enlèvent les limitations de l’infrastructure physique sous-jacente, offrant ainsi une flexibilité dans la conception du réseau.

Les technologies d’encapsulation jouent un rôle crucial dans ce domaine. En encapsulant les paquets originaux dans de nouveaux en-têtes, elles permettent de traverser des réseaux intermédiaires qui n’auraient pas les capacités nécessaires pour traiter directement le trafic original.

Les mécanismes de découverte et d’apprentissage dynamiques sont essentiels pour maintenir les mappings entre les adresses overlay et underlay. Ces processus permettent aux réseaux overlay de s’adapter automatiquement aux changements dans l’infrastructure physique sous-jacente.

Technologies VXLAN et GENEVE

VXLAN (Virtual Extensible LAN) représente l’une des technologies d’overlay les plus répandues dans les centres de données modernes, les Datacenter.

L’encapsulation VXLAN et son format de trame sont étudiés en détail. En encapsulant les trames Ethernet dans des paquets UDP, VXLAN permet d’étendre les réseaux de couche 2 au-delà des limites traditionnelles, tout en profitant des avantages du routage IP pour l’acheminement entre les différents sites.

Les mécanismes de flood-and-learn versus le contrôle plane distribué sont comparés pour comprendre les différentes approches de gestion du trafic VXLAN. Si le mode flood-and-learn s’avère simple à déployer, les solutions à plan de contrôle distribué offrent une évolutivité et une efficacité supérieures, particulièrement dans les déploiements à grande échelle.

GENEVE (Generic Network Virtualization Encapsulation) est présenté comme une évolution prometteuse. Sa flexibilité accrue grâce à son système d’options extensibles permet de supporter une gamme plus large de cas d’utilisation et d’innovations futures, sans nécessiter de modifications fondamentales du protocole.

Cas d’Utilisation des Réseaux Overlay

L’extension des domaines de couche 2 entre centres de données constitue l’un des cas d’utilisation les plus courants. En créant des réseaux virtuels qui s’étendent à travers les frontières physiques, les entreprises peuvent faciliter la mobilité des charges de travail et la reprise après sinistre, tout en maintenant une connectivité transparente pour les applications.

La micro-segmentation pour la sécurité représente une application particulièrement pertinente dans le contexte actuel. En créant des segments logiques isolés au sein d’une infrastructure physique partagée, les organisations peuvent appliquer des politiques de sécurité granulaires et limiter la propagation des menaces, conformément aux principes de défense en profondeur.

Les déploiements multi-locataires dans le cloud illustrent parfaitement la valeur des réseaux overlay. Ces technologies permettent aux fournisseurs de services cloud d’offrir à chaque client des réseaux virtuels isolés, avec des adressages potentiellement chevauchants, tout en maximisant l’utilisation de l’infrastructure physique partagée.

Évolution des Mécanismes de Qualité de Service

Nouveaux Paradigmes de QoS

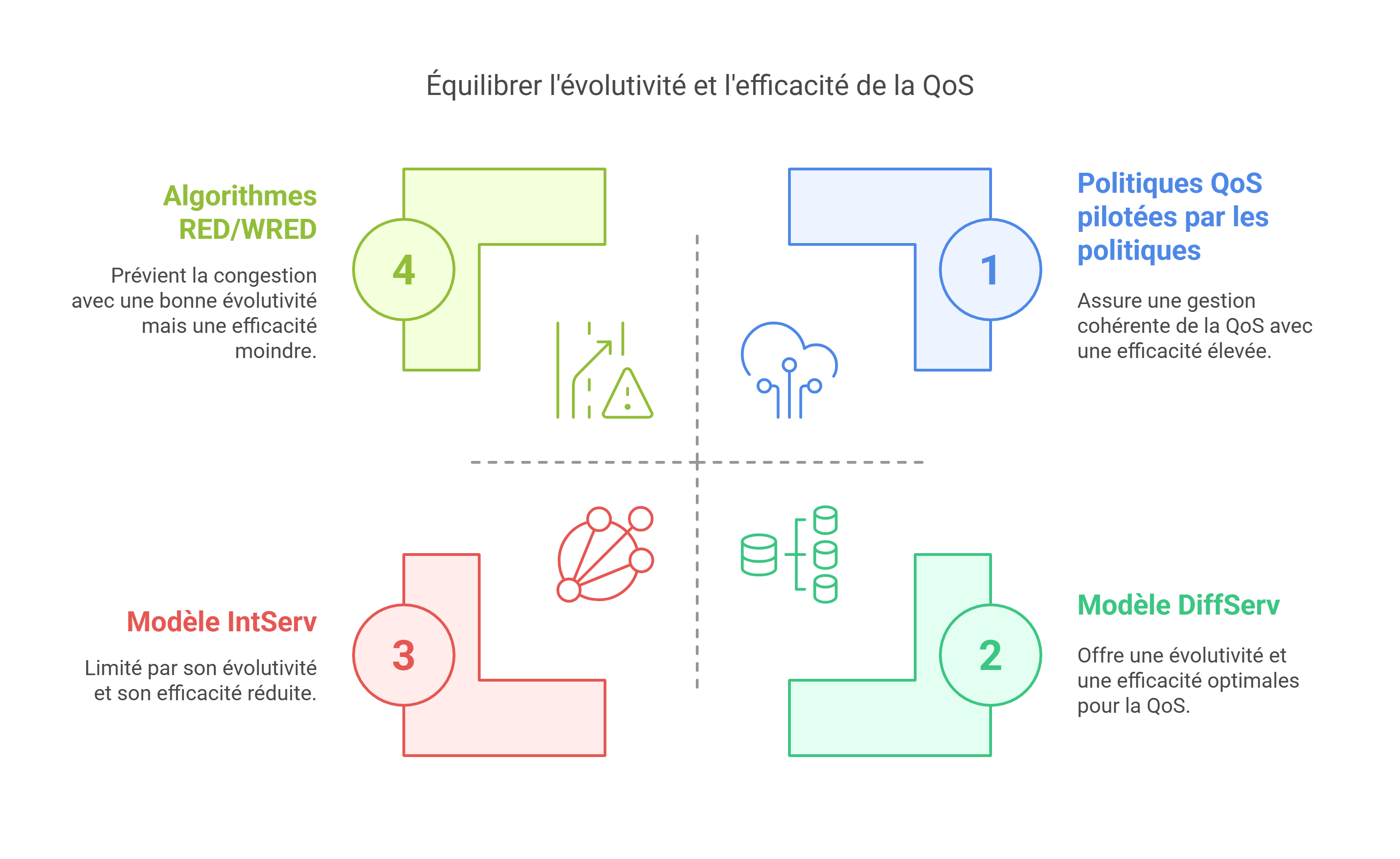

Le modèle DiffServ (Differentiated Services) est présenté comme l’approche dominante pour la QoS dans les réseaux d’entreprise. En classifiant le trafic en un nombre limité de classes de service, ce modèle offre une évolutivité supérieure au modèle IntServ, tout en permettant une différenciation efficace du traitement selon les besoins spécifiques de chaque type de trafic.

Des algorithmes comme RED (Random Early Detection) et WRED (Weighted Random Early Detection) permettent de prévenir la congestion avant qu’elle ne devienne critique, en déclenchant sélectivement des pertes de paquets pour inciter les sources TCP à réduire leur débit.

Cette approche permet une gestion centralisée et cohérente de la QoS à travers l’ensemble du réseau, facilitant ainsi l’application de politiques uniformes et adaptées aux besoins métier.

Intégration QoS et SDN

Le provisionnement dynamique de QoS par API représente une avancée significative. En exposant les capacités QoS via des interfaces programmables, les réseaux permettent une adaptation automatique des politiques en fonction des besoins changeants des applications, sans intervention manuelle des administrateurs réseau.

En prenant en compte des facteurs comme l’identité de l’utilisateur, sa localisation, l’heure de la journée ou le type d’appareil utilisé, ces systèmes peuvent appliquer des politiques hautement personnalisées pour optimiser l’expérience utilisateur.

L’orchestration de bout en bout de la QoS à travers des domaines hétérogènes devient possible grâce aux architectures SDN. Cette approche permet de maintenir une qualité de service cohérente tout au long du parcours des données, même lorsque celles-ci traversent différents types de réseaux ou différentes zones administratives.

Métriques et Surveillance Avancées

La mesure et la surveillance de la qualité de service bénéficient de nouvelles approches, reflétant l’importance croissante de la visibilité dans les réseaux.

Si les mesures actives permettent de tester précisément des paramètres spécifiques en injectant du trafic de test, les mesures passives offrent une vue non intrusive du comportement réel du réseau sous charge opérationnelle.

Les métriques orientées expérience utilisateur prennent une importance croissante. Au-delà des indicateurs techniques traditionnels comme la latence ou la perte de paquets, des métriques composites comme le MOS (Mean Opinion Score) ou le QoE (Quality of Experience) tentent de quantifier l’impact réel sur l’expérience perçue par les utilisateurs finaux.

Conclusion

L’évolution du routage et de la commutation reflète la transformation profonde que connaissent les réseaux. De l’amélioration des protocoles traditionnels à l’émergence du NFV et les réseaux overlay, cette mise à jour du programme CCNA témoigne de la complexité croissante mais aussi de la flexibilité accrue des infrastructures réseau.

Maîtriser ces concepts avancés du routage et de la commutation constitue donc un atout essentiel pour tous ceux qui souhaitent passer la certification mais aussi rester à la pointe de cette profession en constante évolution.